L’Intelligence artificielle (IA) est d’usage courant désormais pour les capacités de renseignement (ISR). Pour le Canada, il faut répondre aux dilemmes éthiques majeurs issus du recours à l’IA, en veillant à préserver la vie privée tout en participant à l’analyse des métadonnées nécessaire pour préserver la sécurité du pays. La gouvernance de l’ISR est scrutée de près par le public canadien.

L’intelligence artificielle dans l’ISR : défis éthiques et perspectives canadiennes face aux menaces hybrides

Artificial Intelligence in ISR: The Ethical Stakes and Perspectives for Canada in the Face of Hybrid Threats

Artificial intelligence (AI) is now in everyday use in intelligence, surveillance and reconnaissance (ISR) capabilities. Canada needs to act upon the major ethical dilemmas which arise from the use of AI, being careful to respect individuals’ privacy yet at the same time conducting the analysis of metadata necessary to the security of the country. The governance of ISR is closely scrutinised by the Canadian population.

Dans un contexte de menaces hybrides (cyberattaques, désinformation, ingérences étrangères, etc.), le renseignement doit évoluer. Les innovations technologiques, en particulier l’essor de l’Intelligence artificielle (IA), transforment en profondeur les capacités de Renseignement, la surveillance et la reconnaissance (ISR). Elles offrent des moyens puissants d’analyser des masses de données ouvertes ou classifiées, mais soulèvent des enjeux éthiques nouveaux. Le Canada, allié majeur au sein des Five Eyes, renforce aujourd’hui ses moyens pour contrer ces menaces tout en préservant ses valeurs démocratiques.

Comme le souligne la politologue estonienne spécialiste de la sécurité euro péenne, Maria Mälksoo, « l’effort pour défendre la démocratie » peut paradoxalement la menacer si les garde-fous font défaut (1). De fait, Caroline Xavier, dirigeante du Centre de la sécurité des télécommunications (CST/CSE), l’organisme national de renseignement électromagnétique étranger et l’autorité technique du gouvernement du Canada en matière de cybersécurité et de cyberdéfense, avertit que « l’intelligence artificielle hisse la menace à un niveau inédit en raison de sa capacité à répandre la désinformation » (2). Dans ce cadre, il est capital de comprendre comment le Canada intègre l’IA dans ses systèmes ISR et comment encadrer leur usage éthique.

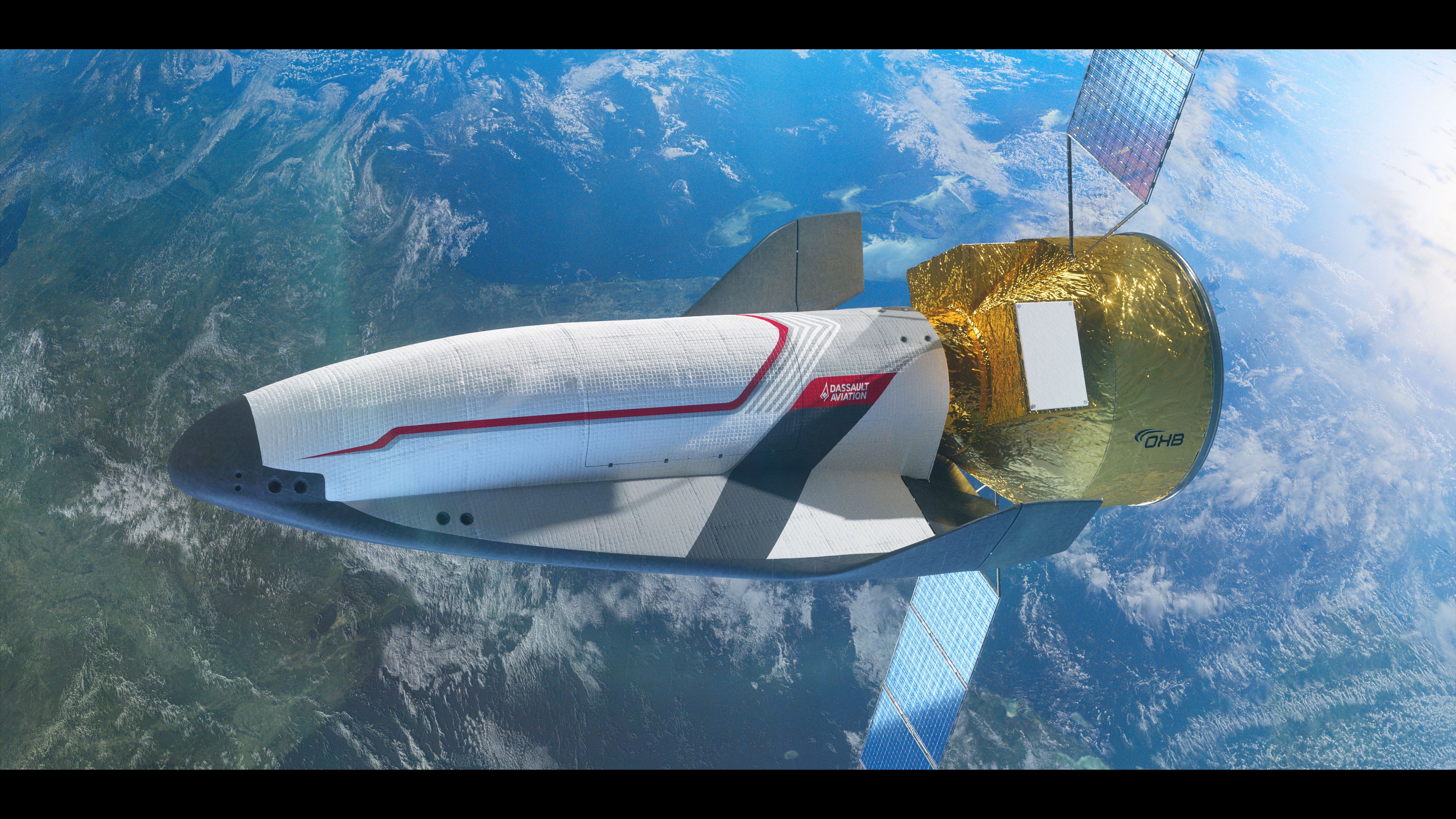

Capacités technologiques de l’IA en ISR

Les agences de renseignement exploitent désormais des volumes de données publics et privés si vastes que seules les techniques d’IA peuvent en extraire du sens. Une note de la Bibliothèque du Parlement du Canada précise que les services de renseignement, dont le CST, acquièrent, analysent, utilisent et partagent de plus en plus d’information accessible au public (renseignement de sources ouvertes – OSINT) : « Compte tenu du volume des données à examiner, l’Intelligence artificielle (IA) – en particulier l’apprentissage automatique – et l’infonuagique seront essentielles » (3). Ce recours à l’IA se concrétise au quotidien. Par exemple, le CST a intégré, au printemps 2024, des fonctions d’IA générative (modèles de fondation) dans sa plateforme Assemblyline de détection de maliciels (4). Cette plateforme utilise l’apprentissage automatique (machine learning) pour trier et synthétiser automatiquement des milliards de fichiers suspects : la génération automatique de rapports d’analyses et l’interrogation par agent conversationnel (chatbot) en sont quelques exemples récents (5). Grâce à ces outils, les analystes peuvent détecter plus vite des schémas menaçants (par exemple, signaux faibles cyber schémas ou patterns d’extrémisme en ligne).

Il reste 87 % de l'article à lire

Plan de l'article